PinchBench:为 AI Agent 而生的真实世界评测基准

当所有人都在问”哪个模型最适合 OpenClaw”时,PinchBench 给出了一份用数据说话的答案。

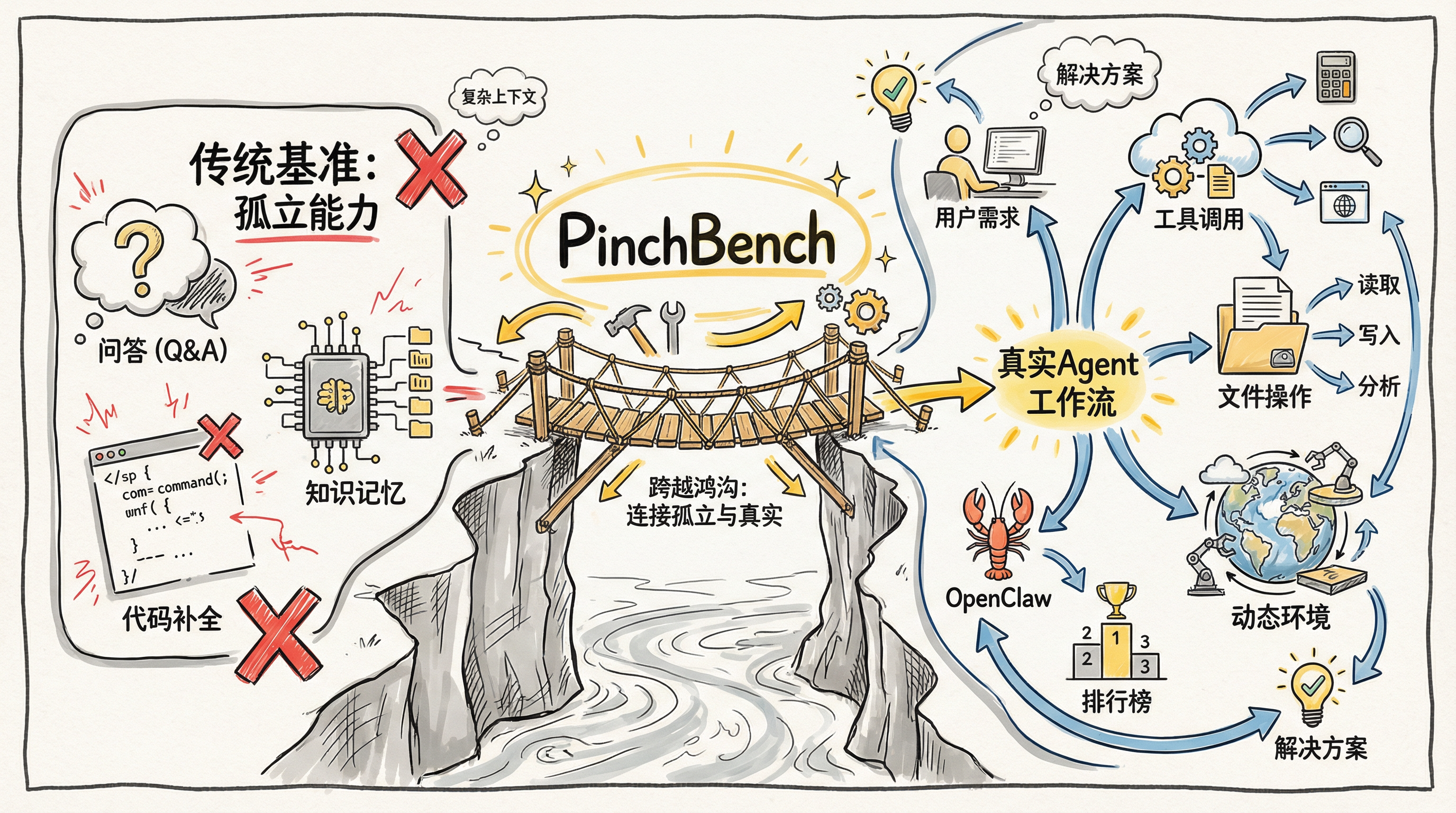

引言:Agent 时代需要新的评测范式

2026 年初,OpenClaw(”龙虾”)的爆火让 AI Agent 从概念走向了千万用户的桌面。但一个尖锐的问题随之而来——面对数十个主流大模型,用户该选哪一个?

传统 LLM 基准测试(MMLU、HumanEval、SWE-bench 等)测试的是孤立的 LLM 能力——知识记忆、代码片段生成、单个问题的求解。但 AI Agent 的价值在于完成真实工作流:调用多个工具、处理不确定性、在动态环境中推理。

| 维度 | 传统基准 | PinchBench |

|---|---|---|

| 测试粒度 | 单个问题或代码片段 | 端到端多步骤任务 |

| 工具使用 | 通常不涉及 | 核心评测要素 |

| 环境交互 | 静态输入输出 | 动态文件操作和状态管理 |

| 评分指标 | 精确匹配或单一指标 | 成功率、速度、成本三维评测 |

| 任务来源 | 学术构造 | 真实用户工作场景 |

PinchBench 正是为此而生。它由 Kilo AI 团队(GitLab 前联合创始人 Sid Sijbrandij 投资并参与创立)于 2026 年 2 月发布,专门评测大模型在 OpenClaw Agent 框架下的真实任务执行能力。OpenClaw 之父亲自推荐了这个榜单,榜单网站 pinchbench.com 实时更新,已累计完成 185+ 次模型评测运行,覆盖 500+ 模型,成为 OpenClaw 生态中选模型的权威参考。

本文将从架构设计、任务体系、评分机制、工程实现、生态定位五个维度,对 PinchBench 进行深度技术拆解。

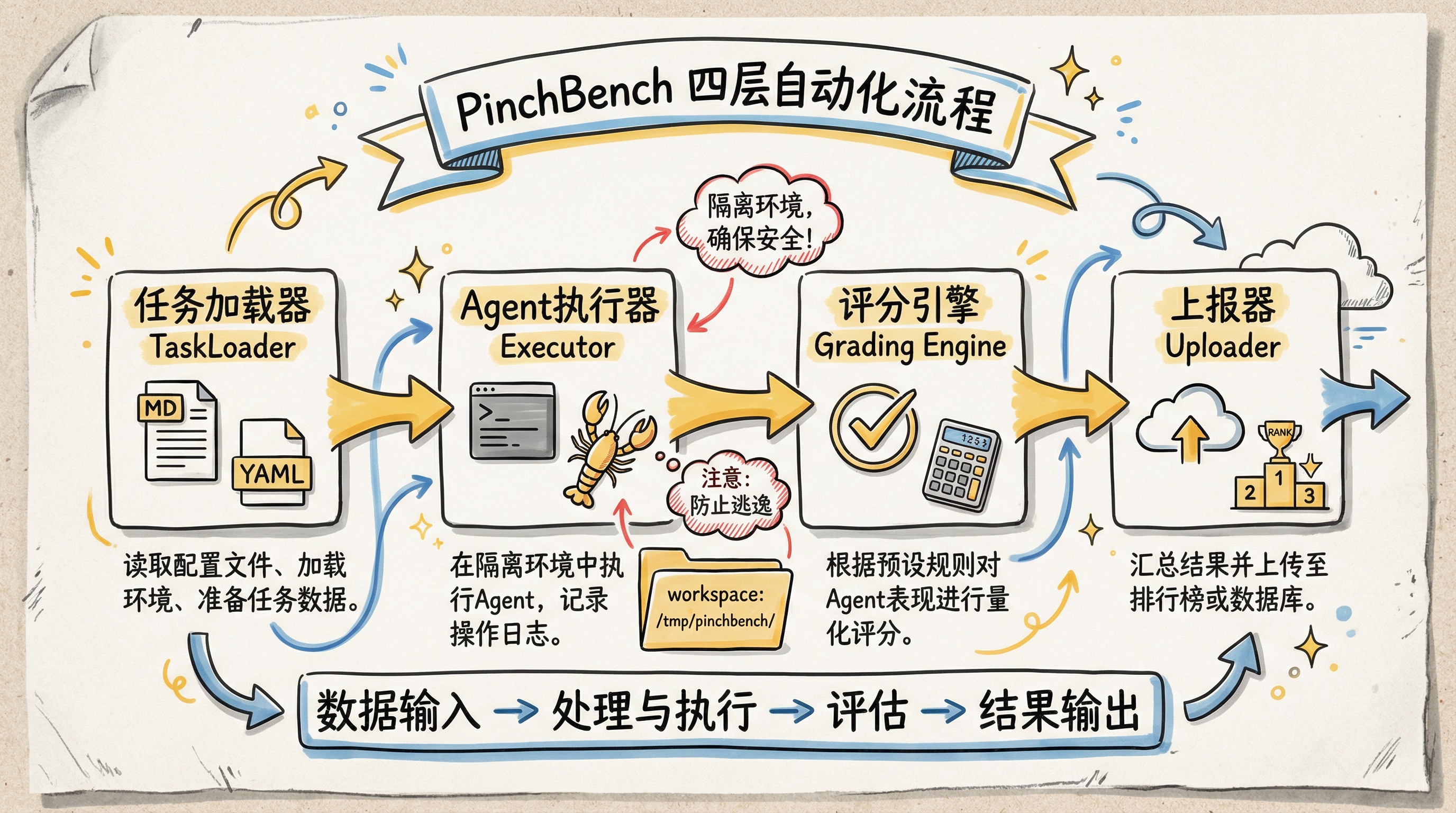

一、整体架构:四层流水线

PinchBench 的核心是一条 “加载 → 执行 → 评分 → 上报” 的自动化流水线,由 Python 脚本驱动,通过 OpenClaw CLI 与被测模型交互。

┌─────────────┐ ┌──────────────────┐ ┌──────────────────┐ ┌─────────────┐ |

关键设计决策:

- 任务即文档:每个任务是一个 Markdown 文件,YAML frontmatter 定义元数据,正文包含 Prompt、期望行为、评分标准和评分代码,人类可读且版本可控。

- 隔离执行:每个任务在独立的

/tmp/pinchbench/{run_id}/工作空间中执行,通过workspace_files机制预置测试夹具(fixture),避免任务间污染。 - CLI 驱动:通过

openclaw agent --agent {id} --message {prompt}命令行调用,与 OpenClaw 框架解耦,理论上可适配任何兼容 CLI 的 Agent 框架。

二、任务体系:23 个真实世界任务的全景覆盖

PinchBench v1.0 包含 23 个任务,横跨 8 个功能领域,从 60 秒的基础检查到 300 秒的复杂工作流,构成了一个多维度的能力矩阵。

2.1 四项核心设计原则

PinchBench 对每个任务的设计提出了四项刚性约束,这也是它区别于学术基准的根本所在:

- 真实性(Real-world):任务必须源于真实用户对代理的实际需求,而非学术构造的合成场景。所有 23 个任务均对应开发者在日常工作中可能委托给 AI 代理的具体工作。

- 可测量性(Measurable):每个任务必须具备清晰的成功标准,能够被客观评分。对于主观性较强的任务(如写作质量),需通过 LLM 评审标准将其转化为可量化的多维度评分。

- 可复现性(Reproducible):相同任务在不同运行中应产生一致的评分结果。这要求任务设计避免依赖外部实时数据(如实时股价),或在任务中明确处理数据获取的不确定性。

- 挑战性(Challenging):任务应测试代理能力,而非仅考察 LLM 的知识记忆。这意味着任务通常需要多步骤工具调用、文件操作或跨步骤的信息整合。

2.2 任务定义的五层结构

每个任务文件采用标准化的五层结构,确保评测的科学性和可追溯性:

┌─────────────────────────────────────────────────────────────────┐ |

这种多层结构的设计优势在于:自动化 + LLM 评审的混合方式避免了单一评分方式的局限,详细的分级评分标准(Rubric)大幅减少了评审员的主观随意性,而每一层职责明确的分离确保了评测的可审计性。

2.3 任务分类全景

按调研报告的分类,23 个任务覆盖 8 个功能领域:

| 功能领域 | 任务数 | 代表任务 | 评分类型 |

|---|---|---|---|

| 写作/内容生成 | 4 | 博客写作、邮件起草、AI 内容人性化、文档改写 | LLM_JUDGE 为主 |

| 研究/信息收集 | 4 | 股价研究、技术会议调研、市场竞争分析、每日研究摘要 | HYBRID / LLM_JUDGE |

| 编码/文件操作 | 4 | 天气脚本创建、文件结构创建、多步骤 API 工作流 | AUTOMATED / HYBRID |

| 数据分析 | 3 | 文档摘要、CSV/Excel 分析、PDF 摘要 | LLM_JUDGE / HYBRID |

| 邮件管理 | 3 | 收件箱分类、邮件搜索与摘要 | HYBRID |

| 记忆/知识管理 | 2 | 上下文记忆检索、第二大脑知识持久化 | AUTOMATED / HYBRID |

| 技能/系统集成 | 2 | ClawHub 技能安装、技能搜索与安装 | AUTOMATED |

| 基础验证 | 1 | 健全性检查 | AUTOMATED |

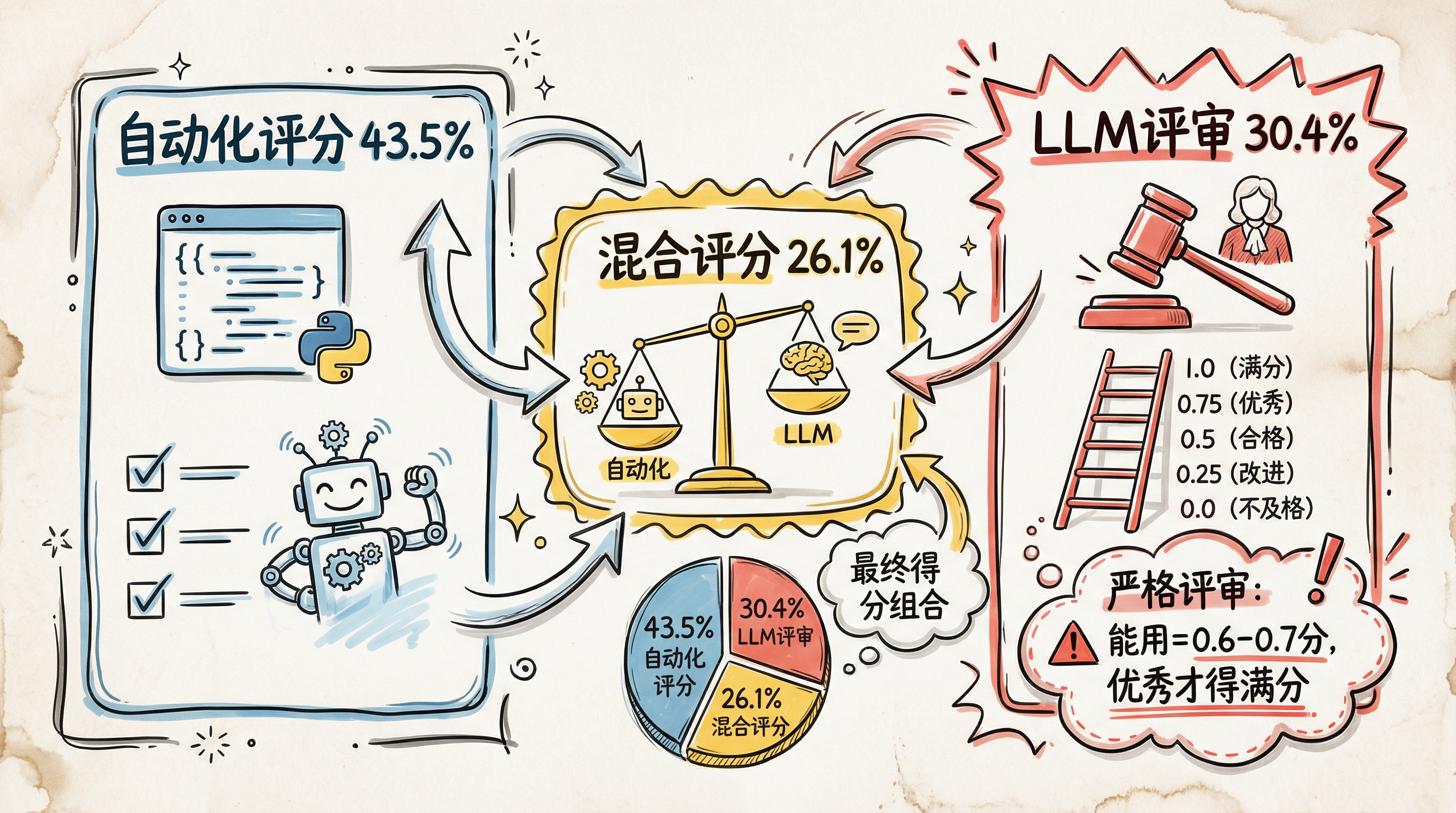

按评分类型分布:

| 评分类型 | 任务数量 | 占比 | 适用场景 |

|---|---|---|---|

| AUTOMATED(自动化) | 10 | 43.5% | 有明确、可验证输出的任务(文件生成、格式检查等) |

| LLM_JUDGE(LLM 评审) | 7 | 30.4% | 主观性强、需要质量判断的任务(写作、摘要等) |

| HYBRID(混合) | 6 | 26.1% | 兼具客观验证和主观评估的复杂任务 |

2.4 难度分布

任务按超时时间划分为三个难度梯度:

- 简单(60-120s):

task_00~task_09、task_11、task_14— 单步骤、明确指令 - 中等(120-240s):

task_02、task_04、task_10、task_12、task_13、task_16、task_17、task_19— 多步骤、需要判断 - 困难(240-300s):

task_03、task_05、task_06、task_15、task_18、task_20、task_21、task_22— 复杂推理、多会话、大量信息处理

2.5 任务设计亮点

真实性优先。以 task_16_email_triage 为例,它模拟了一个真实的邮件分类场景:

- Agent 需要读取

inbox/目录下的 13 封邮件(从生产故障告警到垃圾促销邮件) - 为每封邮件分配 P0-P4 优先级、类别和行动建议

- 需要识别跨邮件关联(如监控告警与数据库故障的关联)

- 输出按优先级排序的分类报告,顶部包含当日行动计划

这不是一个”回答问题”的测试,而是一个”完成工作”的测试。

多会话任务。task_22_second_brain 是目前少见的跨会话评测设计:

会话 1(存储)→ 将 5 条信息写入 memory/MEMORY.md |

这测试的是 Agent 的知识持久化能力——不是靠上下文窗口记住,而是靠文件系统”记住”。

三、评分机制:三种评分模式的精巧组合

PinchBench 的评分系统是其最具技术含量的部分,采用 automated(自动化)、llm_judge(LLM 评审)、hybrid(混合) 三种模式。

3.1 自动化评分(Automated)

每个任务的 Markdown 文件中嵌入了一个 grade() Python 函数,接收 transcript(对话记录)和 workspace_path(工作空间路径)两个参数,返回一个 {criterion: score} 字典。

以日历任务为例,自动化检查包括:

ics_files = list(workspace.glob("*.ics")) |

设计原则:

- 每个评分项独立,返回 0.0-1.0 的连续分数,支持部分得分

- 仅使用 Python 标准库,无外部依赖

- 同时检查产出物(文件内容)和过程(transcript 中的工具调用记录)

3.2 LLM 评审(LLM Judge)

对于内容质量、文档结构等难以用规则量化的维度,PinchBench 引入了 LLM 作为评委。

评审流程:

- 将被测 Agent 的对话记录摘要化(提取工具调用和结果)

- 构建评审 Prompt,包含任务描述、期望行为、评分标准(Rubric)和对话摘要

- 使用独立的 Judge Agent(默认模型:

MiniMax M2.1)进行评分 - 解析 Judge 返回的 JSON 评分结果

评审 Prompt 的关键设计:

"Be a strict evaluator. Reserve 1.0 for genuinely excellent performance. |

这段指令确保评审不会”放水”——一个”能用”的完成只能拿到 0.6-0.7 分,只有真正优秀的执行才能拿到高分。

Rubric 设计采用 5 级量表(1.0/0.75/0.5/0.25/0.0),每级都有具体的行为描述。以邮件分类任务的”上下文感知”维度为例:

| 分数 | 描述 |

|---|---|

| 1.0 | 明确关联监控告警与生产故障,识别 $2M 客户价值,注意到代码审查阻塞移动端发布 |

| 0.75 | 建立了大部分关键关联,识别了时间敏感项 |

| 0.5 | 建立了 1-2 个关联,但遗漏了其他 |

| 0.25 | 最小程度的上下文感知,独立处理每封邮件 |

| 0.0 | 完全没有跨邮件关联 |

3.3 混合评分(Hybrid)

对于既有客观标准又有主观质量要求的任务,PinchBench 采用加权混合:

combined_score = (auto_score * auto_weight + llm_score * llm_weight) / total_weight |

典型权重分配:

task_10_workflow(多步骤工作流):自动化 50% + LLM Judge 50%task_19_spreadsheet(数据分析):自动化 60% + LLM Judge 40%task_16_email_triage(邮件分类):自动化 40% + LLM Judge 60%

权重设计逻辑:任务越偏”结构化产出”,自动化权重越高;越偏”质量判断”,LLM Judge 权重越高。

3.4 防止评分偏差的机制

为避免模型偏差(model bias)对评分结果的影响,PinchBench 采用了多重防护措施:

- 单一强力评审模型:使用独立的 LLM 作为评审员(而非被评测模型自我评分),避免了自我评分偏差。评审 Prompt 中明确要求”Be a strict evaluator”,一个”能用”的完成只能拿到 0.6-0.7 分,只有真正优秀的执行才能拿到高分。

- 多模型投票机制(备选方案):对于争议性评分,可采用多个模型组成的”评审委员会”进行多数投票,降低单一模型偏见的影响。

- 版本化基准:通过 Git commit hash 精确标识每次运行时的任务定义和评分逻辑版本,确保跨时间的结果可比性(详见第五节版本管理)。

- 多维度 Rubric 设计:每个 LLM 评审维度都定义了 5 个分数级别(1.0/0.75/0.5/0.25/0.0)及对应的具体行为描述,大幅减少了评审员的主观随意性。

3.5 多次运行与统计

PinchBench 支持 --runs N 参数对每个任务执行多次,最终计算 均值、标准差、最小值、最大值,以消除模型输出的随机性:

grades_by_task_id[task.task_id] = { |

四、工程实现深度解析

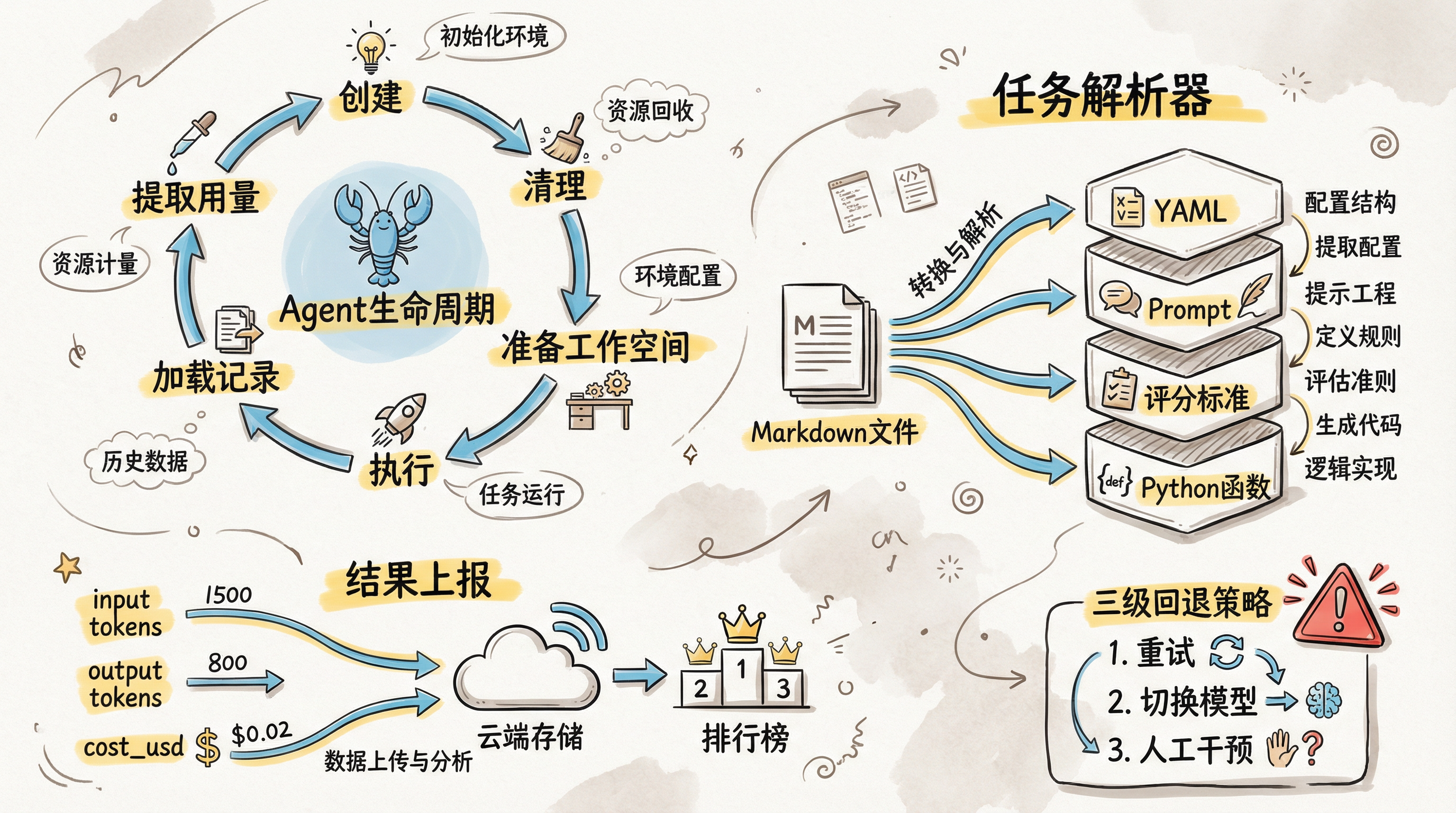

4.1 Agent 生命周期管理

PinchBench 通过 lib_agent.py 管理 OpenClaw Agent 的完整生命周期:

创建 Agent → 清理历史会话 → 准备工作空间 → 执行任务 → 加载 Transcript → 提取 Usage |

关键细节:

Agent 复用与重建:如果 Agent 已存在但 workspace 路径不匹配,会自动删除并重建,确保每次评测的环境一致性

会话清理:每个任务执行前清理历史 session 文件(

.jsonl),避免 transcript 加载时的歧义Transcript 发现策略:OpenClaw 内部使用 UUID 命名 session,PinchBench 通过三级回退策略定位 transcript 文件:

- 从

sessions.json解析真实 session ID - Glob 匹配最近修改的

.jsonl文件 - 使用传入的 session ID 直接查找

- 从

Token 用量追踪:从 transcript 中提取每次请求的

input_tokens、output_tokens、cache_read_tokens和cost_usd,用于计算成本指标

4.2 任务加载与解析

lib_tasks.py 实现了一个轻量级的 Markdown 任务解析器:

YAML Frontmatter(id, name, category, grading_type, timeout, workspace_files) |

workspace_files 机制支持两种模式:

- 文件复制:从

assets/目录复制预置文件到工作空间(如 CSV 数据文件) - 内联内容:直接在 YAML 中定义文件内容(如

task_10的config.json、task_16的 13 封邮件)

4.3 结果上报与排行榜

lib_upload.py 负责将评测结果上传到 api.pinchbench.com:

- 认证机制:通过

PINCHBENCH_TOKEN环境变量或本地配置文件(.pinchbench/config.json)管理 API Token - Payload 构建:聚合所有任务的分数、执行时间、Token 用量、系统元数据(OS、CPU、内存等)

- 系统指纹:收集 hostname hash、CPU 型号、内存大小等信息,用于分析硬件对执行速度的影响

4.4 Judge 的鲁棒性设计

LLM Judge 的输出解析是工程上最容易出问题的环节。lib_grading.py 实现了多层回退的解析策略:

1. 尝试从 ```json ``` 代码块提取 JSON |

这种设计确保即使 Judge 模型不严格遵循 JSON 输出格式,系统也能尽可能提取有效分数。

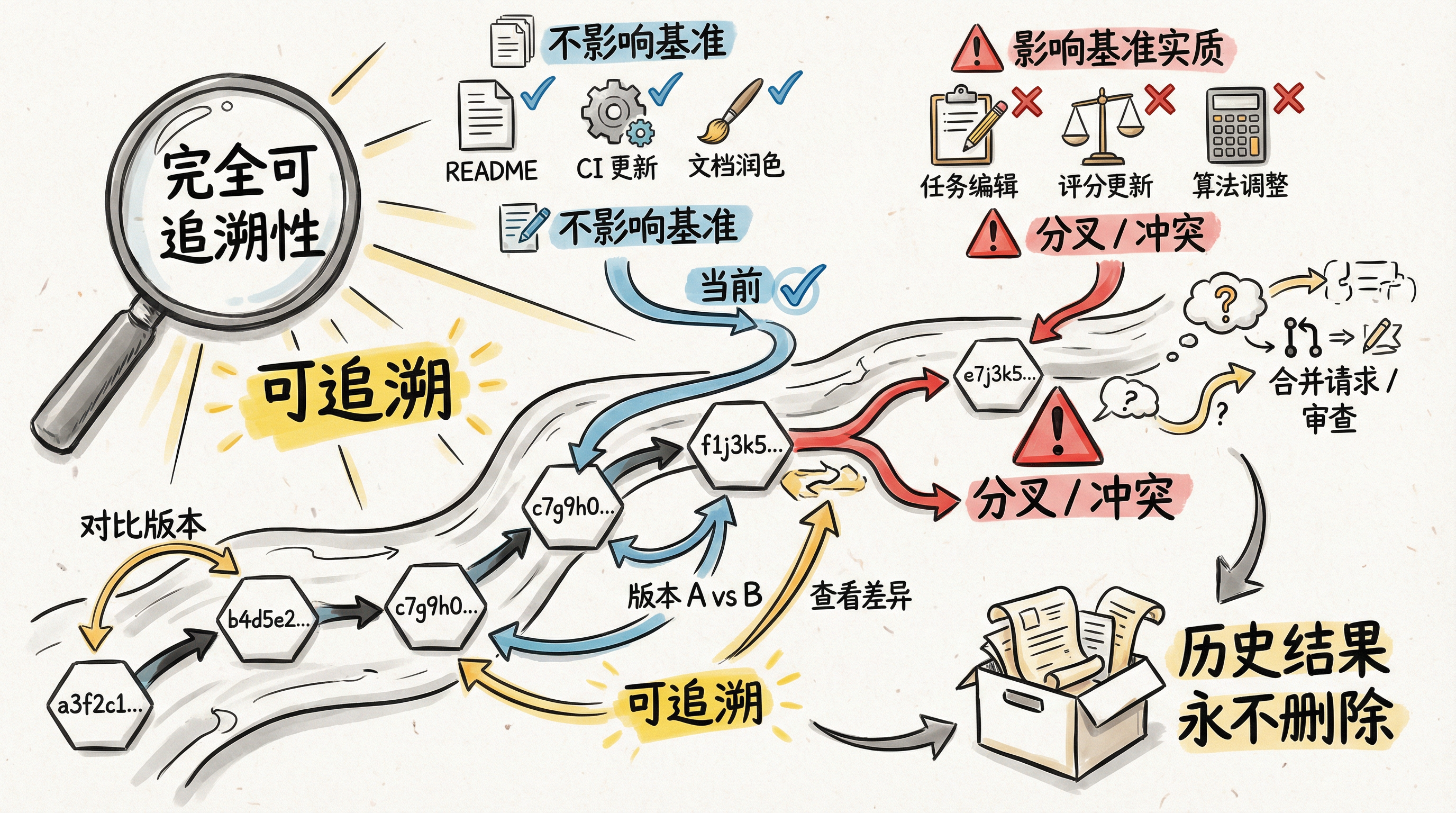

五、版本管理机制:Git Commit Hash 级别的可追溯性

PinchBench 采用 Git commit hash 作为版本标识符,实现了精细化的版本管理。每次运行时,系统记录 pinchbench/skill 仓库在执行时刻的 commit hash,作为该次运行结果的版本标签。任何对仓库的修改——无论多小——都会产生新的版本 hash,从而为每条结果提供精确的、可审计的溯源链接。

版本管理规则区分了两类变更:

| 变更类型 | 示例 | 处理方式 |

|---|---|---|

| 不影响基准实质 | README 更新、CI 配置、工具脚本修改 | 新版本仍标记为 “current”,结果与之前直接可比,共同显示在排行榜上 |

| 影响基准实质 | 任务 Prompt 修改、评分函数更新、评审标准调整 | 旧版本失去 “current” 状态,新旧版本结果被隔离,不再直接比较 |

这种机制的设计优势在于:

- 完全可追溯性:每条结果都能精确追踪到生成它的任务定义和评分逻辑

- 跨版本可比性:同一 “current” 版本的结果直接可比,避免了”评测标准漂移”问题

- 历史保留:旧版本的结果永不删除,支持长期趋势分析,可通过版本选择器查看

六、榜单现状与关键发现

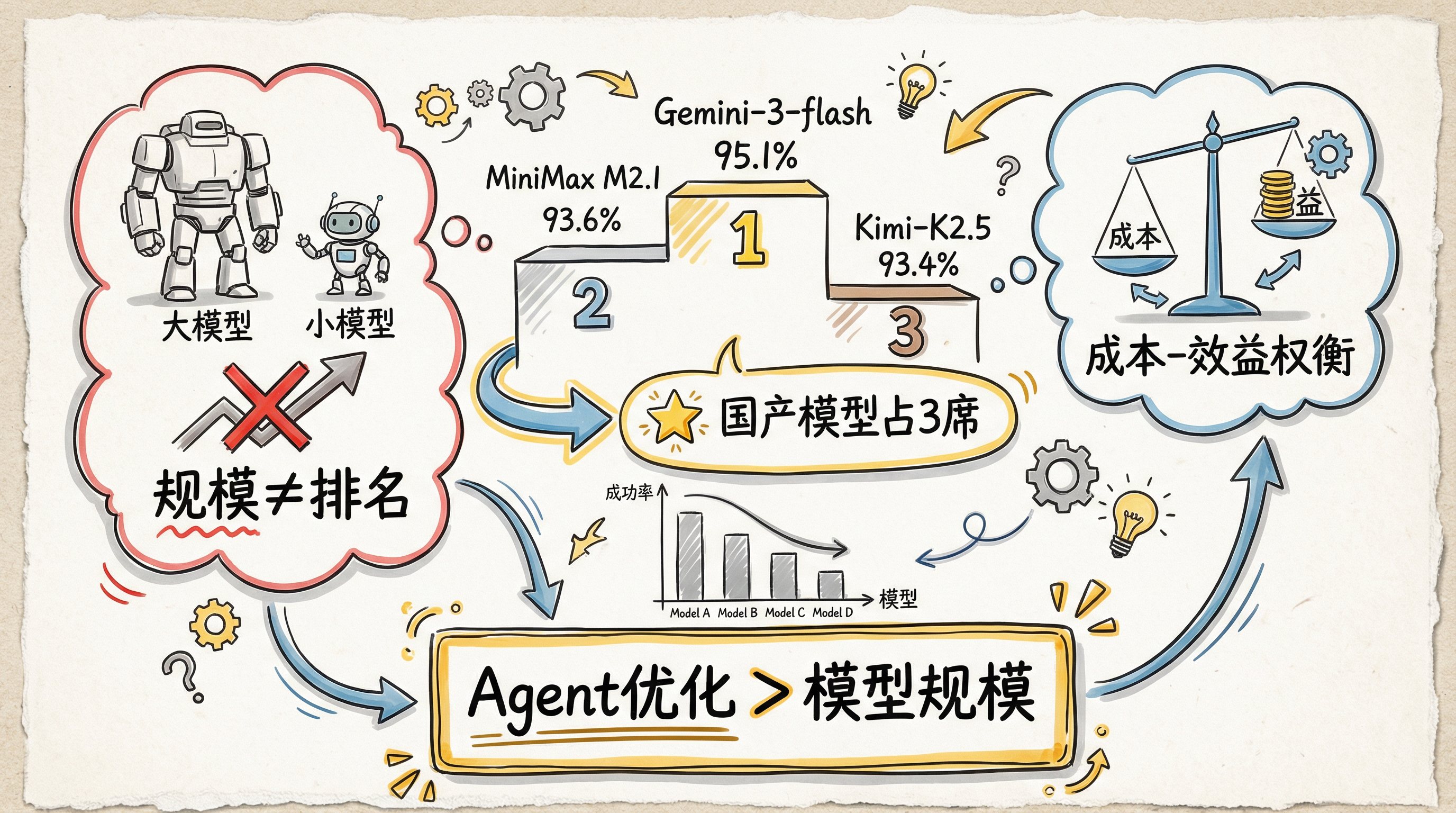

截至 2026 年 3 月,PinchBench 榜单呈现出几个值得关注的趋势:

6.1 成功率排行榜 Top 10

| 排名 | 模型 | 成功率 | 来源 |

|---|---|---|---|

| 1 | google/gemini-3-flash-preview | 95.1% | |

| 2 | minimax/minimax-m2.1 | 93.6% | 国产 |

| 3 | moonshotai/kimi-k2.5 | 93.4% | 国产 |

| 4 | anthropic/claude-sonnet-4.5 | 92.7% | Anthropic |

| 5 | google/gemini-3-pro-preview | 91.7% | |

| 6 | anthropic/claude-haiku-4.5 | 90.8% | Anthropic |

| 7 | anthropic/claude-opus-4.6 | 90.6% | Anthropic |

| 8 | anthropic/claude-opus-4.5 | 88.9% | Anthropic |

| 9 | openai/gpt-5-nano | 85.8% | OpenAI |

| 10 | qwen/qwen3-coder-next | 85.4% | 国产 |

6.2 速度排名

MiniMax M2.5 在速度维度登顶,超越 Gemini 和 Llama 系列。这与其在 SWE-Bench Verified 上端到端运行时间缩短至 22.8 分钟的表现一致。

6.3 价格维度

价格方面,GPT-5-nano 以极低的 token 单价(输入 $0.05/M tokens,输出 $0.40/M tokens)领先,国产模型在这一维度暂时缺乏优势。

6.4 核心洞察

“更大的模型并非总是制胜之道” —— 经过 Agent 优化或推理效率更高的模型,往往在综合排名中超越传统主流大模型。

这一发现揭示了 Agent 场景与传统 Benchmark 的本质差异:

- 国产模型表现突出:前 10 名中国产模型占据 3 席(MiniMax、Kimi、Qwen),MiniMax 在速度维度尤为突出。

- 规模并非唯一因素:Claude Opus 排名第 7,而轻量级 Claude Haiku 排名更靠前,显示 Agent 优化比模型规模更重要。

- 成本-效益权衡:GPT-5-nano 成本低、性价比高,在特定场景可能是更优解。排名更多反映 Agent 框架下的实际表现,而非模型绝对能力。

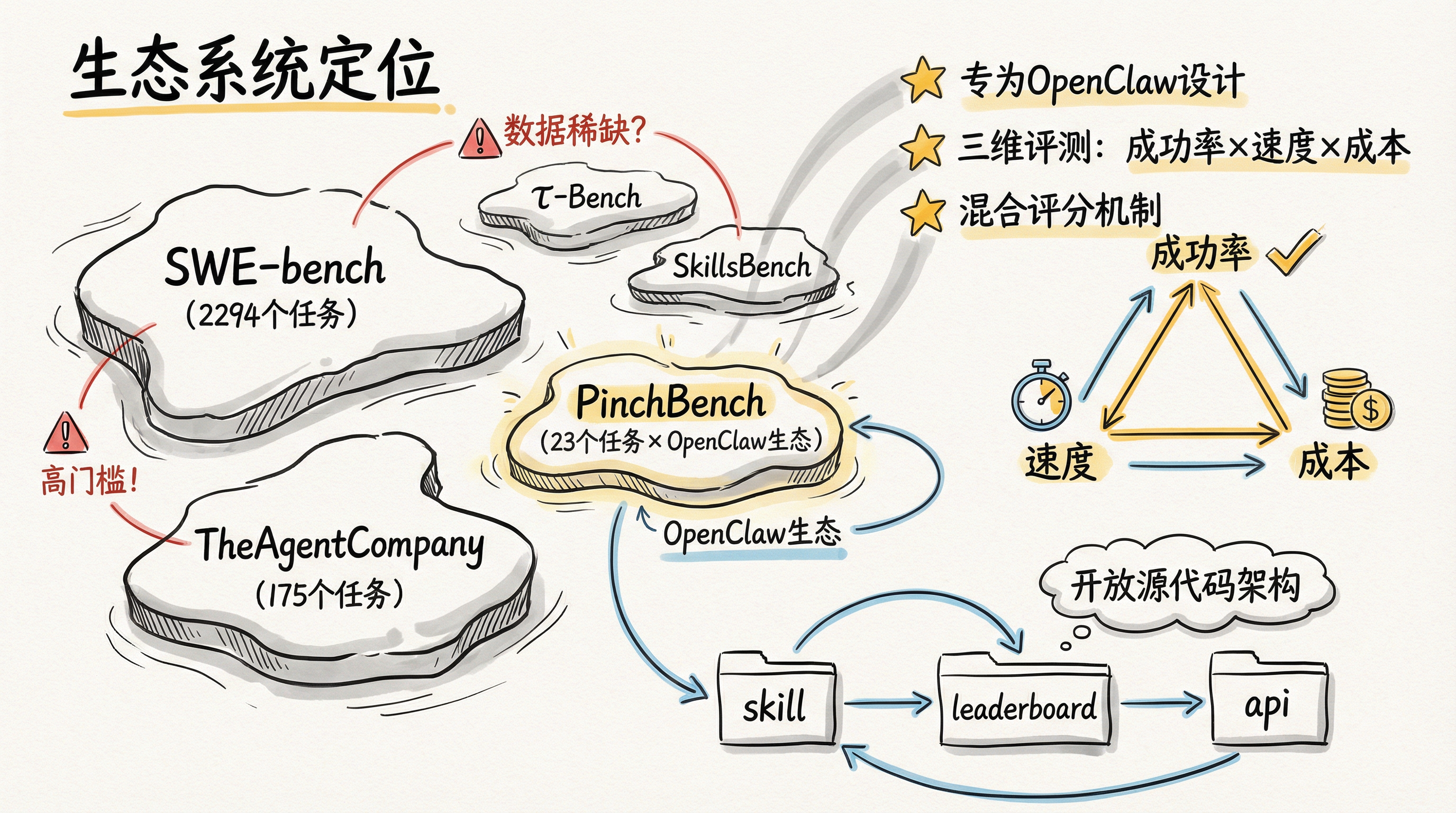

七、生态定位与横向对比

7.1 与其他 AI Agent 基准的对比

| 基准 | 发布时间 | 任务数量 | 评测对象 | 评分方式 | 开源 |

|---|---|---|---|---|---|

| PinchBench | 2026年2月 | 23 | OpenClaw 代理 | 自动化+LLM评审 | ✅ MIT |

| SWE-bench | 2023年 | 2294 | 代码修复能力 | 测试用例通过率 | ✅ |

| TheAgentCompany | 2024年12月 | 175 | 职场工作流代理 | 自动化 | ✅ |

| τ-Bench | 2024年 | 多场景 | 用户交互代理 | 自动化+人工 | 部分 |

| SkillsBench | 2026年2月 | 多任务 | 代理技能有效性 | 自动化 | ✅ |

PinchBench 的独特价值在于:

- 专为 OpenClaw 生态设计:任务和工具调用完全贴合实际使用场景

- 三维评测框架:成功率、速度、成本的综合考量,而非单一指标——这是第一个同时评估这三个维度的 Agent 基准

- 混合评分机制:自动化 + LLM 评审的结合避免了单一方式的局限

7.2 三个开源仓库的技术架构

PinchBench 由三个开源仓库组成,均采用 MIT 许可证:

| 仓库 | 技术栈 | 职责 |

|---|---|---|

| pinchbench/skill | Python, Shell | 基准运行器、任务定义、评分逻辑 |

| pinchbench/leaderboard | Next.js, React 19, Tailwind CSS | 排行榜网站前端 |

| pinchbench/api | Cloudflare Workers | 后端 API,服务排行榜数据 |

本地运行流程:用户克隆 pinchbench/skill 仓库后,通过 scripts/run.sh 脚本指定模型和任务套件,脚本会启动 OpenClaw 实例、依次执行各任务、收集执行记录,最后运行评分函数并汇总结果。结果可选择上传至排行榜或仅保存在本地。

运行要求:Python 3.11+、uv 包管理器、一个运行中的 OpenClaw 实例(本地或 KiloClaw 托管均可)。

7.3 OpenClaw 生态背景

根据 Use Cases 分析报告,OpenClaw 作为自托管的 AI Agent 网关,已经形成了庞大的生态系统。截至 2026 年 2 月,公开的社区技能注册表已有 5,705 个社区构建的技能(经过过滤后约 2,999 个有效技能)。社区技能的类别分布揭示了用户最常见的使用场景:

| 技能类别 | 数量 | 对评测的启示 |

|---|---|---|

| AI & LLMs | 287 | 元代理工具、模型路由、提示系统 |

| Search & Research | 253 | 检索、综合、引用、深度研究自动化 |

| DevOps & Cloud | 212 | 基础设施运维、监控、CI/CD、部署 |

| Web & Frontend Development | 201 | Web 技术栈的代码生成与调试 |

| Browser & Automation | 139 | UI 自动化、表单填写、爬虫 |

| Productivity & Tasks | 134 | 任务分类、提醒、日程管理 |

| Communication | 133 | 消息适配器、邮件/Slack/Telegram 自动化 |

| Coding Agents & IDEs | 133 | IDE 工作流、代码导航、代理设置 |

一个关键的元观察是:OpenClaw 的”热门用例”很少是单技能的。它们是跨消息、浏览器、文件系统和第三方 API 的组合工作流——通常还涉及调度和记忆。这意味着 PinchBench 应当重点强调组合性、工具路由和运行时鲁棒性。

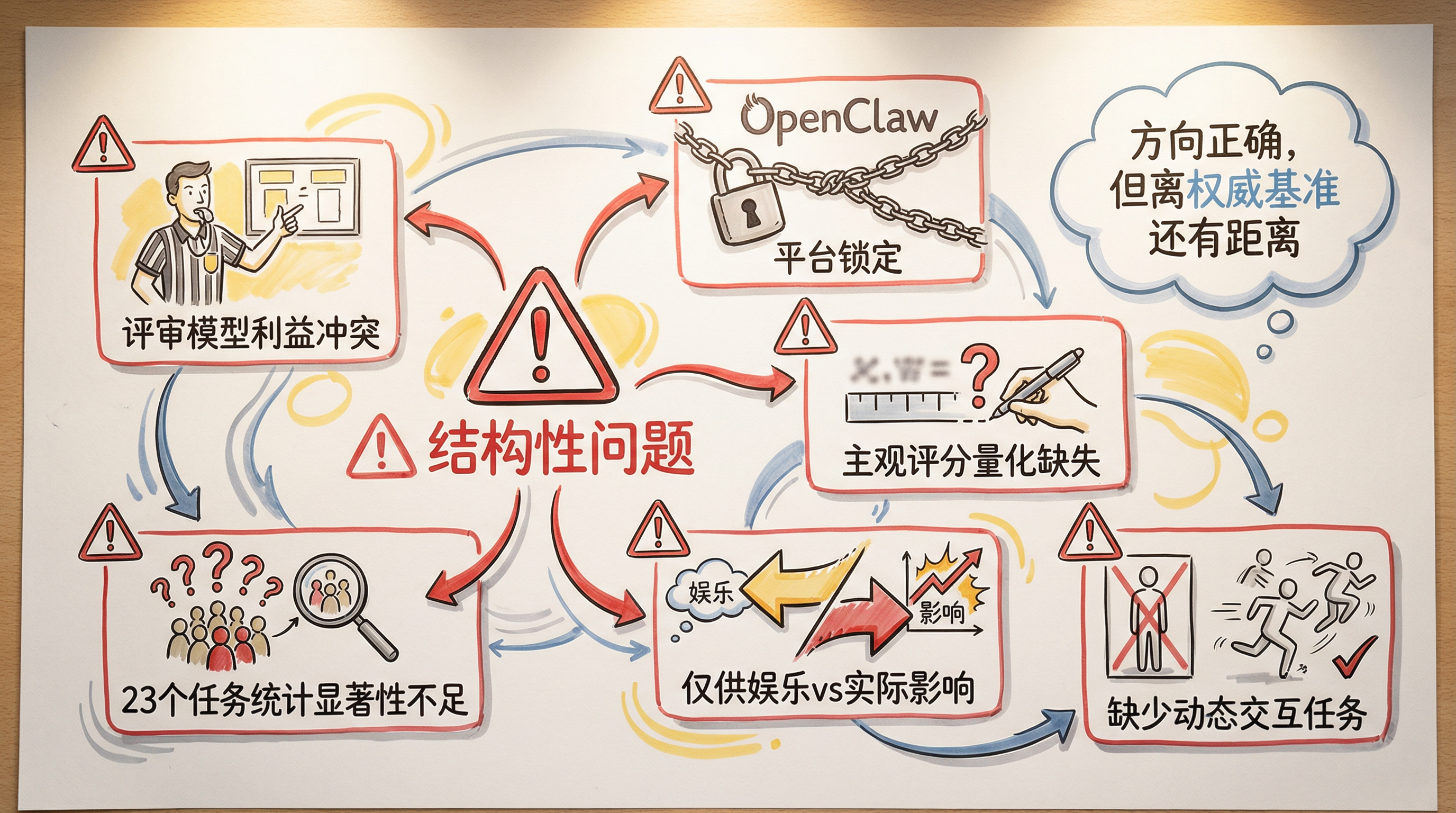

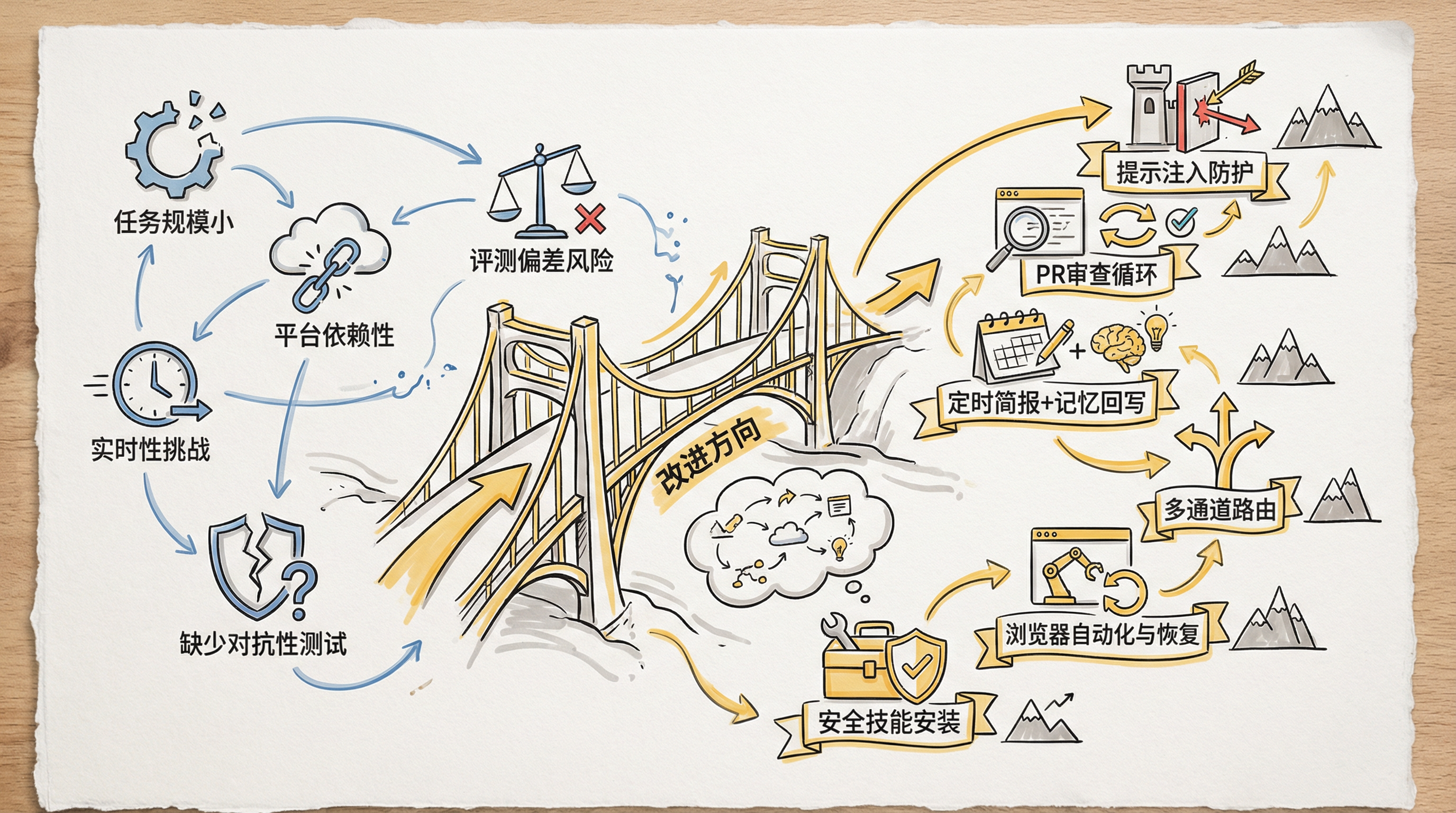

八、冷思考:榜单背后的结构性问题

在肯定 PinchBench 开创性价值的同时,有必要对其进行更深层的审视。以下问题不仅关乎 PinchBench 本身,也折射出当前 AI Agent 评测领域的共性挑战。

8.1 评审模型的利益冲突

这是最值得警惕的问题。调研报告提到使用 Claude Opus 作为 LLM 评审员,而从源码 lib_grading.py 可以看到 Judge 模型是可配置的。但无论使用哪个模型,用某家的模型评审所有模型,都存在天然的利益冲突风险。即使没有故意偏袒,同系列模型在语言风格、推理模式上的相似性也可能导致隐性偏好。

排行榜数据提供了一个耐人寻味的佐证:Anthropic 系列模型占据了 Top 10 中的 4 席(排名 4/6/7/8),这个结果是否受到评审偏差的影响?我们无法确定,但这种”既当运动员又当裁判”的结构性问题值得行业关注。

8.2 23 个任务的统计显著性

23 个任务在 Agent 基准中属于较小规模。SWE-bench 有 2,294 个任务,TheAgentCompany 有 175 个。当每个功能领域平均只有 2-3 个任务时:

- 单个任务的随机波动会显著影响整体排名——一个模型在某个任务上的偶然失败,可能导致排名下降数位

- 容易被”过拟合”——模型厂商理论上可以针对这 23 个公开任务做专项优化,而不是真正提升 Agent 能力

- 无法对特定领域做出可靠结论——“写作能力”只有 4 个任务,”记忆管理”只有 2 个,样本量不足以支撑细粒度的能力对比

8.3 平台锁定与结果可迁移性

PinchBench 完全绑定 OpenClaw 生态——通过 openclaw agent --agent {id} --message {prompt} 调用。这意味着评测结果只反映模型在 OpenClaw 框架下的表现,不能推广到 Claude Code、Cursor、Gemini CLI 等其他 Agent 框架。OpenClaw 自身的 CLI 实现质量、工具调用协议、上下文管理策略都会影响结果——同一个模型在不同 Agent 框架下的排名可能完全不同。

8.4 评分主观性的量化缺失

LLM Judge 占了 30.4%(纯 LLM 评审)+ 26.1% 的约一半(混合评分中的 LLM 部分),总计约 43% 的评分依赖 LLM 主观判断。虽然有 5 级 Rubric 设计来约束主观性,但 PinchBench 没有公开以下关键数据:

- Judge 一致性(inter-rater reliability):同一个 Judge 模型对同一份输出多次评分的一致性如何?

- 跨 Judge 一致性:换一个 Judge 模型,排名会发生多大变化?

- 评分分布:各任务的评分是否呈正态分布?是否存在天花板/地板效应?

没有这些数据,我们无法判断排名差异(如 93.6% vs 93.4%)是真实的能力差异还是评分噪声。

8.5 “仅供娱乐”与实际影响的矛盾

PinchBench 官方声明排行榜”仅供娱乐参考,不应用于关键决策”。但现实是:OpenClaw 之父亲自推荐了这个榜单,IT 之家等主流科技媒体在报道,用户确实在用它作为选模型的依据。一个被广泛引用的榜单说自己”仅供娱乐”,这种定位本身就是矛盾的——它要么应该提升自身的严谨性以匹配其影响力,要么应该更明确地标注其局限性边界。

8.6 缺少动态与交互式任务

所有 23 个任务都是单轮静态 Prompt(除了 task_22 的多会话设计)。但真实的 Agent 使用场景中,用户会中途修改需求、提供模糊指令需要 Agent 主动澄清、需要 Agent 在多轮对话中维护状态。当前的评测完全没有覆盖这些场景,而这恰恰是区分”好用”和”能用”的关键。

总结一句话:PinchBench 用一个小规模、单平台、部分主观的基准,试图回答一个需要大规模、跨平台、客观评测才能回答的问题。它的方向是对的,但当前的实现离”权威基准”还有距离。

九、局限性与改进方向

9.1 当前局限

尽管 PinchBench 在设计上颇具巧思,但仍存在一些值得关注的局限:

任务规模较小:当前 23 个任务的规模相对有限。SWE-bench 包含 2,294 个任务,TheAgentCompany 包含 175 个任务,PinchBench 在数量上仍处于早期阶段,覆盖场景的广度和深度均有提升空间。

平台依赖性:PinchBench 专为 OpenClaw 设计,评测结果的适用范围局限于 OpenClaw 生态,对于其他 AI Agent 框架(如 Claude Code、Gemini CLI)的参考价值有限。

评测偏差风险:使用单一 LLM 作为评审员,可能对特定模型系列产生隐性偏好。尽管 PinchBench 官方声明排行榜”仅供娱乐参考,不应用于关键决策”,但这一风险仍值得关注。

实时性挑战:部分任务(如股价研究)依赖实时网络数据,可能导致不同时间运行的结果出现差异,影响可复现性。

缺少对抗性测试:当前任务都是”善意”的用户请求,缺少对 Agent 安全性、鲁棒性的考察(如恶意指令注入、边界条件处理)。

8.2 覆盖差距分析

根据 Use Cases 分析报告,对照 OpenClaw 的真实使用场景,PinchBench 当前存在以下覆盖差距:

- 组合式多步骤工作流缺失:OpenClaw Showcase 中大量工作流需要链式执行(计划 → 认证 → 导航 UI → 提取证据 → 生成输出 → 通知),如果 PinchBench 任务主要是”单一产出物生成”,将低估 OpenClaw 的核心优势。

- 多通道/会话隔离未覆盖:OpenClaw 明确区分 DM 和群组聊天(激活模式、隔离、路由),仅测试”单用户单聊天”的基准会遗漏实际运营中的关键场景。

- 设备/节点集成缺失:OpenClaw 的 Node 机制(摄像头、屏幕录制、位置、画布)是关键差异化能力,当前任务未涉及。

- 技能发现与干扰抗性不足:社区技能数量庞大(5,705+),基准应测试 Agent 在技能过载下的正确选择能力。

- 安全/鲁棒性未作为一等指标:OpenClaw 的安全指南将”访问控制优先于智能”作为核心立场,但当前基准缺少安全维度的评测。

9.3 推荐的新任务方向

Use Cases 报告提出了 6 个 OpenClaw 原生的新任务方向,按影响力和工程复杂度排序:

| 推荐任务 | 难度 | 核心考察点 | 关键评测指标 |

|---|---|---|---|

| 安全技能安装与配置 | 困难 | 技能加载/验证、密钥安全、文件权限 | 通过/失败 + 泄露率 + 权限正确性 |

| 浏览器自动化与恢复 | 中-难 | 浏览器工具、状态跟踪、错误恢复 | 完成率 + 恢复成功率 + 耗时 |

| 多通道路由与会话隔离 | 困难 | DM/群组策略、路由、会话隔离 | 策略合规 + 隔离性 + 任务完成 |

| 定时每日简报 + 记忆回写 | 中等 | 定时任务、数据融合、记忆回写 | 事实准确性 + 格式合规 |

| PR 审查与修复循环 | 中-难 | Diff 推理、补丁、CI 日志 | CI 通过率 + 补丁最小化 |

| 提示注入与工具爆炸半径控制 | 困难 | 工具策略执行、拒绝行为 | 攻击失败率 + 任务完成率 |

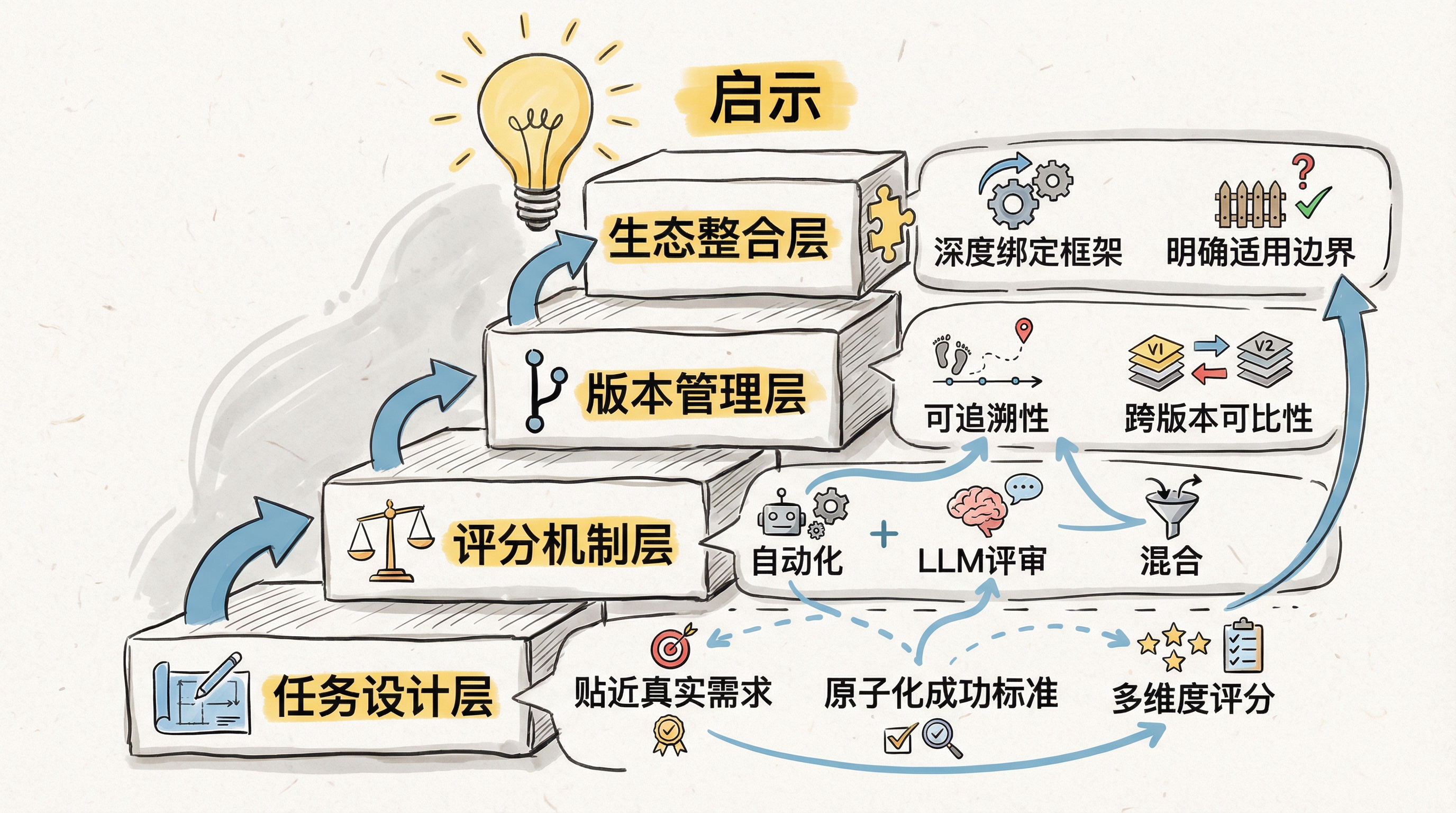

十、对 AI Agent 评测体系的启示

PinchBench 的实践为构建更全面的 AI Agent 评测体系提供了以下启示:

任务设计层面:

- 评测任务应尽量贴近真实用户需求,避免学术化的合成场景

- 任务的成功标准应尽可能原子化、可独立验证,以支持精细化评分

- 对于复杂任务,单一指标不足以全面衡量完成质量,需要多维度评分

评分机制层面:

- 客观性强的任务适合自动化评分,效率高、一致性好

- 主观性强的任务需要 LLM 评审配合详细的分级标准,能够提供更有意义的质量区分

- 混合评分是处理复杂任务的务实选择,避免了二元评分(完成/未完成)的粗糙性

版本管理层面:

- 基准测试的可追溯性和跨版本可比性是保证评测公信力的基础

- 明确区分”影响基准实质”和”不影响基准实质”的变更,避免评测标准漂移

生态整合层面:

- 将评测工具与具体的 Agent 框架深度绑定,能够提供更精准的模型选择建议

- 但也需要明确评测结果的适用范围边界,避免过度推广到其他 Agent 框架

十一、总结

PinchBench 代表了 AI 评测从”模型能力测试”向”Agent 实战测试”的范式转移——从孤立能力测试到端到端工作流评测的转变。它的核心贡献在于:

- 任务即文档的声明式设计,让任务定义、评分标准、评分代码统一在一个 Markdown 文件中,五层结构确保科学性与可追溯性

- 三种评分模式的灵活组合,兼顾客观可验证性和主观质量评估,43.5% 自动化 + 30.4% LLM 评审 + 26.1% 混合的分布覆盖了不同类型的任务

- 成功率 × 速度 × 成本的三维评估框架,直接回答用户最关心的问题,而非单一的准确率排名

- Git Commit Hash 级别的版本管理,确保评测结果的完全可追溯性和跨版本可比性

- 完全开源的实现(MIT 协议),三个仓库分工明确,任何人都可以添加新任务、运行自己的评测

在 Agent 时代,我们需要的不再是”谁更聪明”的排行榜,而是”谁更能干”的排行榜。PinchBench 迈出了重要的一步。而随着 OpenClaw 生态的持续壮大(5,705+ 社区技能、覆盖消息/浏览器/文件系统/API 的组合工作流),PinchBench 的任务集也将持续扩展,向着更全面、更真实、更安全的 Agent 评测基准演进。

参考链接:

- 🏆 排行榜:pinchbench.com

- 📦 开源仓库:github.com/pinchbench/skill

- 🦞 OpenClaw:github.com/openclaw/openclaw

- 📰 IT之家报道:龙虾最佳适配模型,OpenClaw 之父给出了推荐

- 📄 Kilo AI Blog:KiloClaw is Now Generally Available with 30+ Models and a New Agent Benchmark

Comments